数年前まで、3Dスキャンといえば電子レンジサイズの専用スキャナーと、ハードウェアより高価なソフトウェアが必要でした。今ではLiDARセンサー搭載のiPhoneとAppleのObject Capture APIで、わずかな写真から実用的な3Dモデルを生成できます。

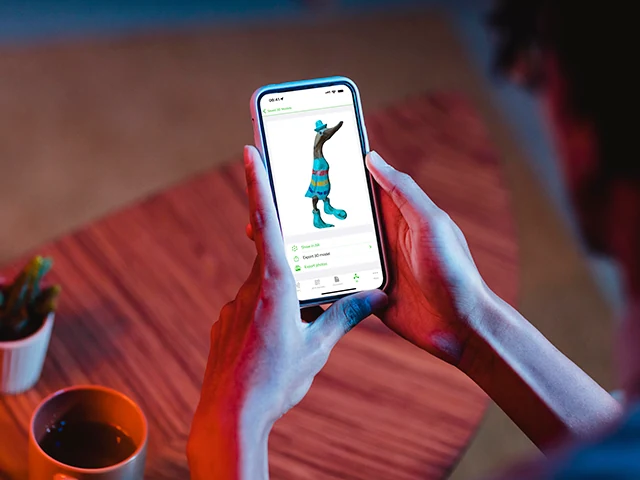

NFC.cool Toolsの3Dスキャン機能は、そのパイプラインをポケットに収まるワークフローに包んでいます。

実際に起きていること

2つの技術が連携します:

フォトグラメトリー - アプリが物体を様々な角度から数十枚の写真で撮影します。フォトグラメトリーエンジン(iOSではAppleのObject Capture API)が写真間で一致する特徴を見つけ、それらを3Dメッシュに三角測量します。

LiDAR - LiDARセンサー搭載のiPhone(iPhone 12以降のProモデル)では、各フレームがセンサーからの深度測定で補強されます。これは2つの点でメッシュを大きく改善します:スケールが正確になる(モデルが実物大)、明確な視覚的特徴のない表面(白い壁、光沢のあるカーブ)でも使えるジオメトリが得られる - フォトグラメトリー単独では失敗するところでも。

どちらのステップも考える必要はありません - アプリが撮影を案内し、再構築はオンデバイスで実行されます。

良いスキャンを撮るコツ

実践的なルールをいくつか:

物体の周りをゆっくり移動する。 アプリは大まかに連続したカバレッジを期待します。一方の側から反対側へジャンプせず、周りを歩きましょう。

物体をフレーム内に保つ。 物体の周りに一定のマージンがあれば問題ありませんが、端で切れるとデータが失われます。

均一な照明。 強い影はフォトグラメトリー段階を混乱させます。拡散光(青空、ソフトボックス、室内の自然光)が最もクリーンなメッシュを生みます。

テクスチャのある物体は特徴のない物体よりよくスキャンされる。 柄入りのマグカップはほぼ完璧にスキャンされます。磨かれた金属球は本当に難しい。LiDARは後者を助けますが、完全には救えません。

各角度で一瞬静止する。 モーションブラーがディテールを食います。

スキャン全体は20〜40秒の歩行、その後30〜60秒の処理。

エクスポート形式

NFC.cool Toolsは下流で実際に必要な形式にエクスポートします:

.stl - 3Dプリンター。Bambu Studio、Cura、PrusaSlicerなどのスライサーはすべて受け付けます。

.obj - 汎用3D形式。Blender、Cinema 4D、Unity、Unreal、ほぼあらゆるモデリングツールにインポート可能。

.ply - 頂点カラーを保持するメッシュ形式 - UVマップされたマテリアルよりテクスチャが重要な場合に便利。

.usdz - AppleのAR形式。Quick Look、AR Quick Lookにドロップ、またはRealityKitで使用。

.abc(Alembic) - アニメーションパイプライン用。

.usd - Universal Scene Description、最新のほとんどのDCCツールがサポート。

モデルは同じです。形式は単に、どの下流ツールが消費できるかを決めるだけです。

結果でできること

ユーザーから見た最も面白い応用例:

一点物のレプリカを3Dプリント。 拾った物体をスキャンし、スライスし、プリント。

実世界アセットの記録。 遺品整理の記録、博物館のカタログ作成、「おばあちゃんの花瓶って実際どんな形だっけ」。

ARで共有。 iPhoneユーザーに.usdzを送る - 相手がタップするとAR Quick Lookで物体がリビングに浮かんで見える。

ゲームエンジンへ。 Unityのシーンに実世界の小道具を、3Dアーティストなしで90秒でモデリング。

動作する場合と動作しない場合

フォトグラメトリーとLiDARが得意なもの:

固体で不透明な物体

テクスチャや模様のある表面

静止した被写体(スキャン中に動かないもの)

苦戦するもの:

透明または屈折する物体(ガラス、水、レンズ)

高反射の金属

非常に細い特徴(ケーブル、ワイヤー、髪)

動くもの

得意分野では結果は本当に実用的です - おもちゃではありません。それ以外はBlenderでメッシュをクリーンアップするか、限界を受け入れるかになります。

3DスキャンはNFC.cool Tools for iPhoneの一部です:App Store。フォトグラメトリーは最新のあらゆるiPhoneで動作します。LiDAR補強はProモデルで動作します。